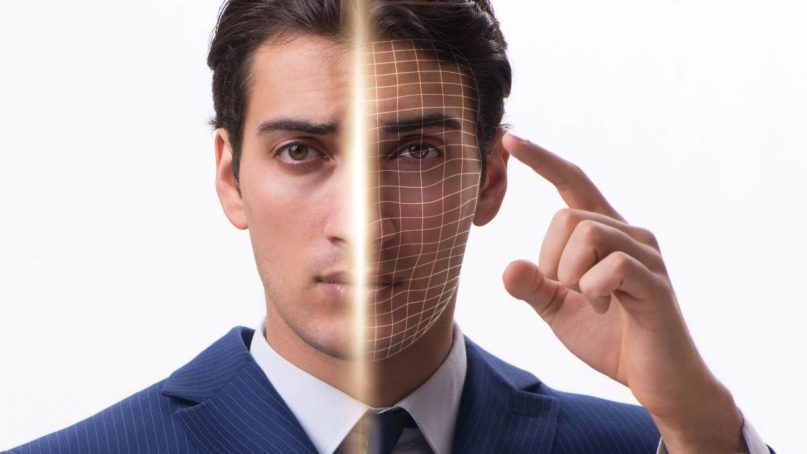

การ์ทเนอร์คาดการณ์ว่าในปี 2569 การโจมตีแบบ Deepfakes ที่สร้างโดยปัญญาประดิษฐ์กับเทคโนโลยีระบุตัวตนบนใบหน้าหรือ Face Biometrics เป็นเหตุให้องค์กรประมาณ 30% มองว่าโซลูชันการยืนยันและพิสูจน์ตัวตนจะไม่น่าเชื่อถืออีกต่อไปหากนำมาใช้แบบเอกเทศ

มร. อากิฟ ข่าน รองประธานฝ่ายวิจัยการ์ทเนอร์ กล่าวว่า “ช่วงทศวรรษที่ผ่านมา มีจุดเปลี่ยนสำคัญด้าน AI เกิดขึ้นหลายประการ นั่นทำให้เกิดการสร้างภาพสังเคราะห์ขึ้นได้ โดยภาพใบหน้าคนจริง ๆ ที่สร้างขึ้นปลอม ๆ เหล่านี้ หรือที่เรียกว่า Deepfakes นั้น เปิดโอกาสให้ผู้ไม่ประสงค์ดีสามารถนำมาใช้เพื่อทำลายระบบการพิสูจน์ทราบตัวตนด้วยไบโอเมตริกซ์หรือทำให้ระบบใช้การได้อย่างไม่มีประสิทธิภาพ ผลที่ตามมาก็คือ องค์กรต่าง ๆ อาจเริ่มตั้งคำถามถึงความน่าเชื่อถือของโซลูชันการยืนยันและพิสูจน์ตัวตน เนื่องจากไม่สามารถบอกได้ว่าใบหน้าบุคคลที่ได้รับการยืนยันนั้นเป็นบุคคลที่มีชีวิตจริงหรือเป็นของปลอมกันแน่”

กระบวนการยืนยันและพิสูจน์ตัวตนโดยใช้เทคโนโลยีไบโอเมตริกซ์บนใบหน้าในวันนี้อาศัยการตรวจจับการโจมตีหลอก หรือ Presentation Attack Detection (PAD) เพื่อประเมินการมีชีวิตอยู่จริงของผู้ใช้ “มาตรฐานและกระบวนการทดสอบในปัจจุบันเพื่อกำหนดและประเมินกลไกของการตรวจจับการโจมตีหลอกนั้นไม่ครอบคลุมการโจมตีผ่านดิจิทัลหรือ Digital Injection Attacks ที่มาจาก Deepfakes ที่สร้างโดย AI ที่สามารถพัฒนาขึ้นได้แล้ววันนี้” มร. ข่าน กล่าวเพิ่มเติม

ผลการวิจัยการ์ทเนอร์ชี้ว่าการโจมตีแบบ Presentation Attack ที่เป็นการปลอมแปลงข้อมูลอัตลักษณ์ทางกายภาพของบุคคลเป็นการโจมตีที่พบบ่อยที่สุด ทว่าการโจมตีแบบ Injection Attack ที่เป็นการแทรกโค้ดลงในโปรแกรมหรือแบบสอบถาม หรือมัลแวร์ในคอมพิวเตอร์เพื่อควบคุมคำสั่งผ่านระยะไกล ในปี 2566 มีอัตราเพิ่มขึ้นถึง 200% ดังนั้นเพื่อป้องกันการโจมตีดังกล่าวองค์กรจะต้องใช้การตรวจจับการโจมตีแบบ Injection Attack Detection (IAD) และการตรวจสอบภาพ หรือ Image Inspection ร่วมด้วย

ใช้การตรวจจับแบบ IAD และเครื่องมือตรวจสอบรูปภาพร่วมกันเพื่อลดภัยคุกคามจาก Deepfake

เพื่อช่วยให้องค์กรธุรกิจสามารถปกป้องตนเองจากภัยคุกคาม Deepfakes ที่พัฒนาขึ้นโดย AI และมีความสามารถเหนือกว่าเทคโนโลยีที่ใช้ในการระบุตัวตนบนใบหน้า ผู้บริหาร CISO และผู้นำจัดการความเสี่ยงต้องเลือกผู้ขายที่สามารถแสดงให้เห็นได้ว่าพวกเขามีความสามารถ มีแผนการจัดการที่เหนือกว่าคุณภาพมาตรฐาน รวมถึงมีระบบมอนิเตอร์ จัดหมวด และกำหนดปริมาณของภัยคุกคามเกิดใหม่นี้

“องค์กรควรเริ่มกำหนดบรรทัดฐานการควบคุมขั้นต่ำด้วยการทำงานร่วมกับผู้ขายที่มีการลงทุนโดยเฉพาะในด้านการลดผลกระทบจากภัยคุกคาม Deepfake ล่าสุด โดยใช้การตรวจจับการโจมตีแบบ Injection Attack Detection (IAD) ควบคู่ไปกับระบบการตรวจสอบภาพ Image Inspection” มร. ข่าน กล่าวเพิ่มเติม

เมื่อกำหนดกลยุทธ์และบรรทัดฐานการควบคุมพื้นฐานแล้ว ผู้บริหาร CISO และผู้นำทีมการจัดการความเสี่ยงจะต้องรวบรวมความเสี่ยงที่จะเกิดขึ้นเพิ่มเติมและตระหนักถึงสัญญาณที่เป็นภัย อาทิ การระบุการใช้งานอุปกรณ์และการวิเคราะห์พฤติกรรม เพื่อเพิ่มโอกาสการตรวจจับการโจมตีในกระบวนการยืนยันตัวตน

นอกจากนี้ ผู้นำด้านความปลอดภัยและการบริหารความเสี่ยงยังมีบทบาทรับผิดชอบในด้านข้อมูลส่วนบุคคลและการจัดการการเข้าถึงควรมีขั้นตอนดำเนินการเพื่อลดความเสี่ยงการโจมตีแบบ Deepfake ที่ขับเคลื่อนจาก AI โดยเลือกเทคโนโลยีที่สามารถพิสูจน์ความเป็นมนุษย์ที่แท้จริงได้หรือนำมาตรการเพิ่มเติมมาใช้เพื่อป้องกันการเข้ายึดบัญชีใช้งาน

ขอบคุณที่มาของบทความและภาพ – การ์ทเนอร์